La inteligencia artificial (IA) es una disciplina joven de sesenta años, que comprende un conjunto de ciencias, teorías y técnicas (incluyendo lógica matemática, estadísticas, probabilidades, neurobiología computacional, ciencias de la computación) que tiene como objetivo imitar las habilidades cognitivas de un ser humano. Iniciada en el contexto de la Segunda Guerra Mundial, sus avances están estrechamente vinculados a los de la informática y han permitido que las computadoras realicen tareas cada vez más complejas, que antes solo podían ser realizadas por un ser humano.

Sin embargo, esta automatización está lejos de la inteligencia humana en el sentido estricto, lo cual ha llevado a que algunos expertos cuestionen el nombre. La etapa final de su investigación (una IA fuerte, es decir, la capacidad de contextualizar problemas especializados muy diferentes de manera totalmente autónoma) no se puede comparar en absoluto con los logros actuales (IA débil o moderada, extremadamente eficientes en su campo de entrenamiento). La IA fuerte, que hasta ahora solo se ha materializado en la ciencia ficción, requeriría avances en la investigación básica (no solo mejoras en el rendimiento) para poder modelar el entorno en su totalidad.

Sin embargo, desde 2010, la disciplina ha experimentado un nuevo auge, principalmente debido a la considerable mejora en la capacidad de cómputo de las computadoras y al acceso a cantidades masivas de datos.

1940-1960: El nacimiento de la IA en el contexto de la cibernética

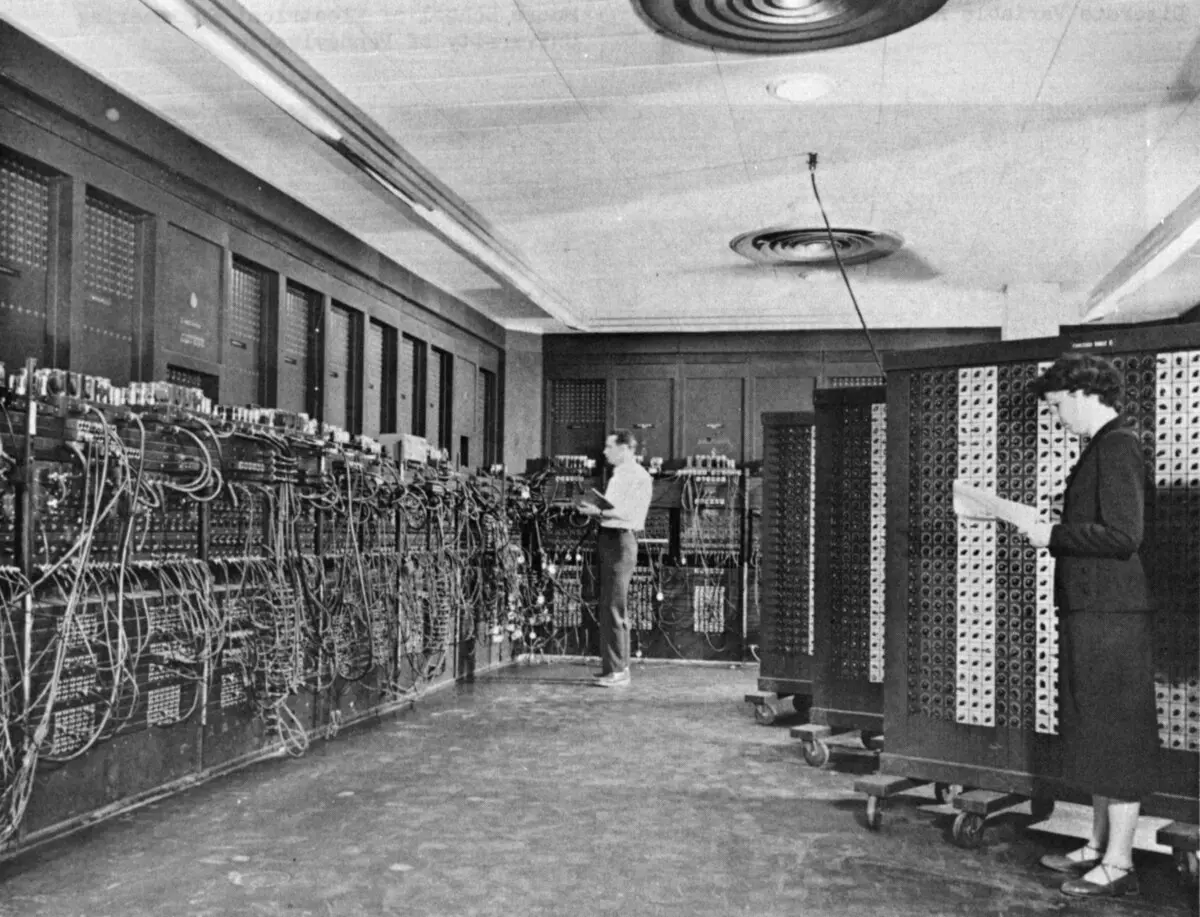

El período entre 1940 y 1960 estuvo fuertemente marcado por la conjunción de desarrollos tecnológicos (de los cuales la Segunda Guerra Mundial fue un acelerador) y el deseo de comprender cómo unir el funcionamiento de las máquinas y los seres orgánicos. Para Norbert Wiener, pionero de la cibernética, el objetivo era unificar la teoría matemática, la electrónica y la automatización como una teoría completa del control y la comunicación, tanto en animales como en máquinas. Poco antes, en 1943, Warren McCulloch y Walter Pitts habían desarrollado un primer modelo matemático y computacional de la neurona biológica (neurona formal).

A principios de la década de 1950, John Von Neumann y Alan Turing no crearon el término IA, pero sentaron las bases de la tecnología detrás de ella: hicieron la transición de las computadoras a la lógica decimal del siglo XIX (que manejaba valores del 0 al 9) y a las máquinas a la lógica binaria (que se basa en el álgebra booleana y maneja cadenas de 0 o 1 más o menos importantes). Los dos investigadores formalizaron así la arquitectura de las computadoras contemporáneas y demostraron que se trataba de máquinas universales, capaces de ejecutar lo que se programa. Por su parte, Turing planteó por primera vez la cuestión de la posible inteligencia de una máquina en su famoso artículo de 1950 computing machinery and intelligence y describió un juego de imitación, en el que un humano debería ser capaz de distinguir en un diálogo de teleimpresora si está hablando con un hombre o una máquina. Aunque este artículo es controvertido (este test de turing no parece calificar para muchos expertos), a menudo se cita como el origen de la cuestión de los límites entre lo humano y lo máquina.

El término ia se le atribuye a John McCarthy del MIT (Instituto Tecnológico de Massachusetts), a quien Marvin Minsky (Universidad Carnegie Mellon) define como la construcción de programas de computadora que participan en tareas que actualmente se realizan de manera más satisfactoria por los seres humanos porque requieren procesos mentales de alto nivel, como: aprendizaje perceptual, organización de la memoria y razonamiento crítico. La conferencia de verano de 1956 en el Dartmouth College (financiada por el Instituto Rockefeller) se considera la fundadora de la disciplina. Cabe destacar que esta conferencia fue más un taller que una conferencia en sí. Solo seis personas, incluyendo a McCarthy y Minsky, estuvieron presentes de manera constante durante este trabajo (que se basó esencialmente en desarrollos basados en la lógica formal).

Aunque la tecnología setutorial siendo maravilloso y prometedora (véase, por ejemplo, el artículo de 1963 de Reed C. Lawlor, miembro del Colegio de Abogados de California, titulado lo que las computadoras pueden hacer: análisis y predicción de decisiones judiciales ), la popularidad de la tecnología disminuyó a principios de la década de 1960. Las máquinas tenían muy poca memoria, lo que dificultaba el uso de un lenguaje de programación. Sin embargo, ya existían algunas bases que todavía están presentes en la actualidad, como los árboles de soluciones para resolver problemas: el IPL (lenguaje de procesamiento de información) permitió escribir en 1956 el programa LTM (máquina teórica de la lógica) que tenía como objetivo demostrar teoremas matemáticos.

Herbert Simon, economista y sociólogo, profetizó en 1957 que la IA lograría vencer a un humano en el ajedrez en los próximos 10 años, pero la IA entró en un primer invierno. La visión de Simon resultó ser correcta... 30 años después.

1980-1990: Sistemas expertos

En 1968, Stanley Kubrick dirigió la película 2001: odisea del espacio en la que un ordenador, HAL 9000 (a una sola letra de IBM), resume todas las cuestiones éticas planteadas por la IA: ¿representará un alto nivel de sofisticación, un bien para la humanidad o un peligro? El impacto de la película no será científico, pero contribuirá a popularizar el tema, al igual que el autor de ciencia ficción Philip K. Dick, quien nunca dejará de preguntarse si, algún día, las máquinas experimentarán emociones.

Fue con la llegada de los primeros microprocesadores a finales de la década de 1970 cuando la IA despegó nuevamente y entró en la edad de oro de los sistemas expertos.

El camino se abrió en el MIT en 1965 con DENDRAL (un sistema experto especializado en química molecular) y en la Universidad de Stanford en 1972 con MYCIN (un sistema especializado en el diagnóstico de enfermedades sanguíneas y la prescripción de medicamentos). Estos sistemas se basaban en un motor de inferencia, programado para ser un reflejo lógico del razonamiento humano. Al ingresar datos, el motor proporcionaba respuestas de alto nivel de experiencia.

Las promesas auguraban un desarrollo masivo, pero la fiebre disminuyó nuevamente a finales de la década de 1980 y principios de la década de 1990. La programación de este tipo de conocimiento requería mucho esfuerzo y, a partir de 200 a 300 reglas, se producía un efecto de caja negra donde no estaba claro cómo la máquina razonaba. El desarrollo y el mantenimiento se volvieron extremadamente problemáticos y, sobre todo, se encontraron formas más rápidas y menos complejas y menos costosas de lograr los mismos resultados. Cabe recordar que en la década de 1990, el término inteligencia artificial casi se había vuelto tabú y se habían adoptado variaciones más modestas en el lenguaje universitario, como computación avanzada.

El éxito en mayo de 1997 de Deep Blue (el sistema experto de IBM) en el juego de ajedrez contra Garry Kasparov cumplió la profecía de Herbert Simon de 1957, pero no respaldó la financiación y el desarrollo de esta forma de IA. El funcionamiento de Deep Blue se basaba en un algoritmo sistemático de fuerza bruta, donde se evaluaban y ponderaban todos los movimientos posibles. La derrota del humano fue muy simbólica en la historia, pero en realidad Deep Blue solo logró tratar un perímetro muy limitado (el de las reglas del juego de ajedrez), muy lejos de la capacidad de modelar la complejidad del entorno.

Desde 2010: Un nuevo auge basado en datos masivos y nueva potencia de cómputo

Dos factores explican el nuevo auge de la disciplina alrededor de 20

- En primer lugar, el acceso a volúmenes masivos de datos. Anteriormente, para poder utilizar algoritmos de clasificación de imágenes y reconocimiento de gatos, por ejemplo, era necesario realizar muestreos. Hoy en día, una simple búsqueda en Google puede encontrar millones de datos.

- Luego, el descubrimiento de la eficiencia muy alta de los procesadores de tarjetas gráficas para acelerar el cálculo de los algoritmos de aprendizaje. El proceso es muy iterativo y antes de 2010, podía llevar semanas procesar la muestra completa. La potencia de cómputo de estas tarjetas (capaces de realizar más de mil billones de transacciones por segundo) ha permitido avances considerables a un costo financiero limitado (menos de 1000 euros por tarjeta).

Este nuevo equipo tecnológico ha permitido algunos éxitos públicos significativos y ha impulsado la financiación: en 2011, Watson, la IA de IBM, ganó los juegos contra 2 campeones de Jeopardy! En 2012, Google X (el laboratorio de búsqueda de Google) logró que una IA reconociera gatos en un video. Se utilizaron más de 16,000 procesadores para esta última tarea, pero el potencial es extraordinario: una máquina aprende a distinguir algo. En 2016, AlphaGo (la IA de Google especializada en el juego de Go) venció al campeón europeo (Fan Hui) y al campeón mundial (Lee Sedol) y luego a sí misma (AlphaGo Zero). Cabe mencionar que el juego de Go tiene una combinatoria mucho más grande que el ajedrez (más que el número de partículas en el universo) y que no es posible obtener resultados tan significativos en términos de fuerza bruta (como lo logró Deep Blue en 1997).

¿De dónde vino este milagro? Un cambio de paradigma completo desde los sistemas expertos. El enfoque se volvió inductivo: ya no se trata de codificar reglas como en los sistemas expertos, sino de permitir que las computadoras las descubran por sí mismas a través de correlaciones y clasificaciones, basándose en una cantidad masiva de datos.

Entre las técnicas de aprendizaje automático, el aprendizaje profundo parece ser el más prometedor para una serie de aplicaciones (incluido el reconocimiento de voz o imágenes). En 2003, Geoffrey Hinton (Universidad de Toronto), Yoshua Bengio (Universidad de Montreal) y Yann LeCun (Universidad de Nueva York) decidieron iniciar un programa de investigación para actualizar las redes neuronales. Los experimentos realizados simultáneamente en Microsoft, Google e IBM con la ayuda del laboratorio de Toronto de Hinton demostraron que este tipo de aprendizaje lograba reducir a la mitad las tasas de error en el reconocimiento de voz. Se lograron resultados similares por parte del equipo de reconocimiento de imágenes de Hinton.

De la noche a la mañana, la mayoría de los equipos de investigación se volcaron hacia esta tecnología con beneficios indiscutibles. Este tipo de aprendizaje también ha permitido avances considerables en el reconocimiento de texto, pero, según expertos como Yann LeCun, aún queda mucho camino por recorrer para producir sistemas de comprensión de texto. Los agentes de conversación ilustran bien este desafío: nuestros teléfonos inteligentes ya saben cómo transcribir una instrucción, pero no pueden contextualizarla completamente y analizar nuestras intenciones.

¿Qué significa soñar con inteligencia artificial?

En la actualidad, la inteligencia artificial ha despertado la imaginación y la curiosidad de muchas personas. Soñar con inteligencia artificial puede tener diferentes significados para cada individuo. Algunas personas pueden soñar con el potencial ilimitado de la IA y cómo puede mejorar nuestras vidas, mientras que otras pueden tener sueños más oscuros y preocuparse por el impacto negativo que la IA podría tener en la sociedad.

En los sueños, la inteligencia artificial puede representar nuestra fascinación por la tecnología y nuestro deseo de explorar nuevos horizontes. También puede simbolizar nuestro deseo de superar los límites de la inteligencia humana y lograr avances significativos en el campo de la computación y la ciencia.

El significado de soñar con inteligencia artificial depende de nuestras experiencias, creencias y emociones personales. Puede ser útil reflexionar sobre el contexto y las emociones asociadas con el sueño para comprender mejor su significado para nosotros mismos.

¿La inteligencia artificial nace o se hace?

La pregunta de si la inteligencia artificial nace o se hace ha sido objeto de debate en la comunidad científica y entre expertos en el campo de la IA. Algunos argumentan que la inteligencia artificial es inherentemente artificial y que no puede ser considerada como una forma de inteligencia en el sentido humano.

Por otro lado, hay quienes sostienen que la inteligencia artificial puede ser desarrollada y mejorada a través del aprendizaje automático y la optimización de algoritmos. Estos defensores creen que, si bien la inteligencia artificial puede no ser igual a la inteligencia humana en su forma actual, tiene el potencial de mejorar y acercarse cada vez más a la inteligencia humana con el tiempo.

La respuesta a esta pregunta puede depender de cómo definamos la inteligencia y cómo evaluemos los logros de la inteligencia artificial. Si consideramos que la inteligencia es la capacidad de procesar información, aprender de ella y tomar decisiones basadas en ese conocimiento, entonces la inteligencia artificial puede ser vista como una forma de inteligencia que se desarrolla a través de algoritmos y datos.

La inteligencia artificial es una disciplina en constante evolución que ha experimentado avances significativos en los últimos años. A medida que continúa desarrollándose, es probable que tenga un impacto cada vez mayor en nuestras vidas y en la forma en que interactuamos con la tecnología. Ya sea que soñemos con el potencial de la inteligencia artificial o tengamos preocupaciones sobre su impacto, es importante seguir investigando y comprendiendo esta maravilloso área de la ciencia y la tecnología.

Si quieres conocer otras notas parecidas a Inteligencia artificial: ¿dónde nacen los sueños? puedes visitar la categoría Inteligencia artificial.